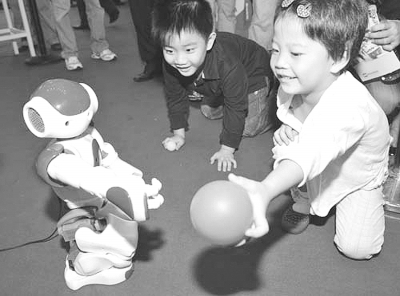

陪伴孩子們嬉戲的智能機器人

英國科研工作者不久前開發出一款命名為“智能機器人”的軟件系統,能讓59.3%的測試者將其誤判為真實的人類。據研制者羅洛·卡朋特推斷,該系統“或許為研制新一代智能機器帶來了契機”。(據光明日報9月19日“科技天地”版報道)

如果說,人類的終極目標是使冰冷的機器成為設身處地為人類“著想”的“助手”,那么,英國科學家的成果只僅僅邁出了萬里長征的第一步。因為“說”是一回事,“做”卻是另一回事。

社會事務的紛繁復雜,必將在具體行動中暴露出這種片面、抽象的對話方式的不足。目前,信息技術的發展已經可以實現機器人的多元選擇,即由機器人根據其軟件內的倫理規約,決定諸如排名先后、利益多寡、評價正負等問題。相信不久的將來,機器人就可以具備相當水平的道德決策能力。但是,機器人的決策是一個純粹的倫理程序輸出過程,機器人本身無法像人一樣批判地分析問題、創造性地提出建議,這就可能導致處理方式的過分僵化和人文關懷的缺失,從而造成不必要的損失。

要解決人工智能面臨的倫理瓶頸,就必須一切從實際出發,建立符合倫理精神的人工智能。辯證法與形而上學的一個根本區別就在于,將實踐的觀點納入視野,在實踐的基礎上歷史地、發展地看待問題,得出客觀公允的結論。歷史告訴我們,即便是同一個社會環境下的倫理準則,也會隨著文明的更新和時間的推移發生質的改變;即便是沒有任何爭議的倫理禁制,也常常由于事出有因或別有隱情而情有可原。因此,要想讓機器人擁有近似人類的思維邏輯,就必須從人性出發,而不是從倫理教材的金科玉律出發,研究人在面對具體問題時的思考角度和思維突破口,唯此,才能發現人類道德進化的規律,才能模擬人類創新思維的路徑,才能形成高仿真度的推斷程序,從而實現決策內容的辯證,使機器人成為“含有人類感情”的道德決策者。

共0條 [查看全部] 網友評論